گزارشی جدید نشان می دهد الگوریتم هایی که شرکت های فناوری برای شناسایی محتوای نژاد پرستانه توسعه داده اند قادر به ردیابی پست های توهین آمیز حاوی ایموجی نیستند.

جی پلاس، به نقل از تلگراف، تحقیقی در دانشگاه آکسفورد نشان میدهد شرکتهای فناوری به دلیل وجود ایموجیها نمیتوانند برخی پستهای محتوای نژاد پرستانه را شناسایی کنند.

مهر نوشت؛ به گفته کارشناسان الگوریتمهایی که گوگل توسعه داده در شناسایی و مسدود کردن محتوای نژاد پرستانه همراه با ایموجی فقط ۱۴ درصد کارآمد است. ایموجیها میتوانند نرم افزار را فریب دهند که محتوای مذکور اهانت آمیز نیست.

محققان انستیتو «اینترنت آکسفورد» در پژوهش خود متوجه شدند فناوری که برای مسدود کردن پستهای توهین آمیز یا حاوی نفرت در فضای آنلاین توسعه یافته، بیشتر اوقات نمیتواند پیامهایی که حاوی ایموجی هستند را شناسایی کند.

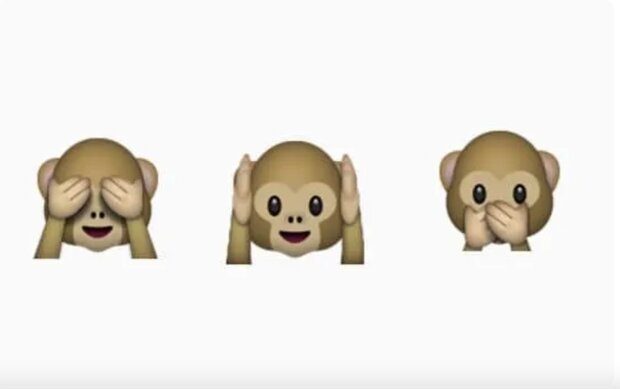

ایموجیهای معمولی مانند سمبلهای میمون، موز و هندوانه بیشتر با محتوای نفرت پراکنی نژاد پرستانه همراه هستند.

پس از شکست تیم فوتبال انگلیس از ایتالیا در فینال مسابقات اروپا، ۳ بازیکن سیاهپوست تیم انگلیس با انبوهی از محتوای نژاد پرستانه از جمله ایموجیها روبرو شدند.

محققان آکسفورد متوجه شدند فناوریهای فعلی بازبینی محتوا به طور مداوم اشتباه میکنند و ایموجیها را توهین آمیز نمیدانند. زیرا نرم افزار هوش مصنوعی به کار گرفته شده برای الگوریتمهای مذکور برای شناسایی چنین ایموجی هایی برنامه ریزی نشده است.

در ماه جولای آدام موسری مدیر اینستاگرام اعتراف کرد این اپ در ردیابی کامنت های توهین آمیزی که برای بازیکنان فوتبال ارسال شده، شکست خورده است.

از سوی دیگر هفته گذشته توئیتر اعلام کرد ۱۶۲۲ پست توهین آمیز که طی فینال مسابقات فوتبال اروپا ارسال شده بوده را حذف کرده است.